三菱総合研究所は生成AI時代の始まりに向け「生成AIラボ」を新設する。それを記念して「三菱総研 生成AIコラム」の連載をお届けする。

世界のAIガバナンスの状況と、広島AIプロセスの創設

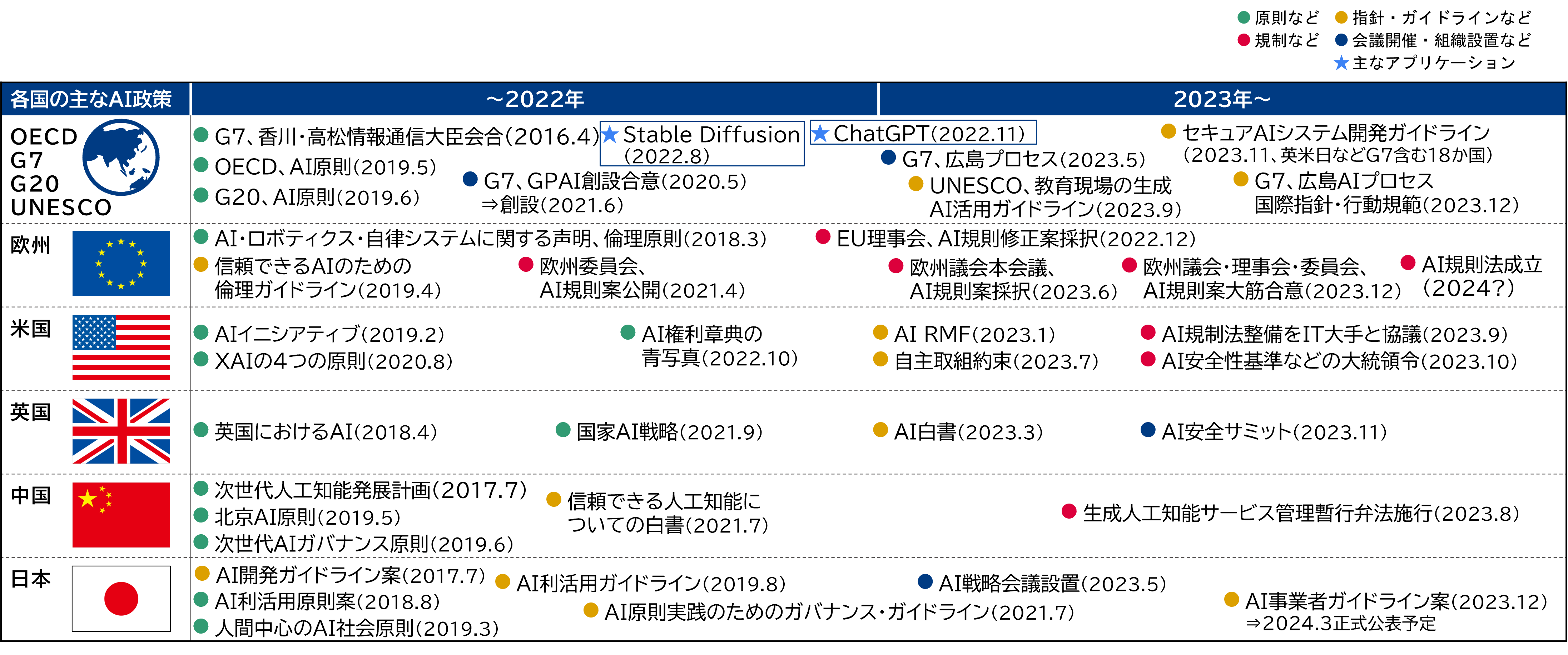

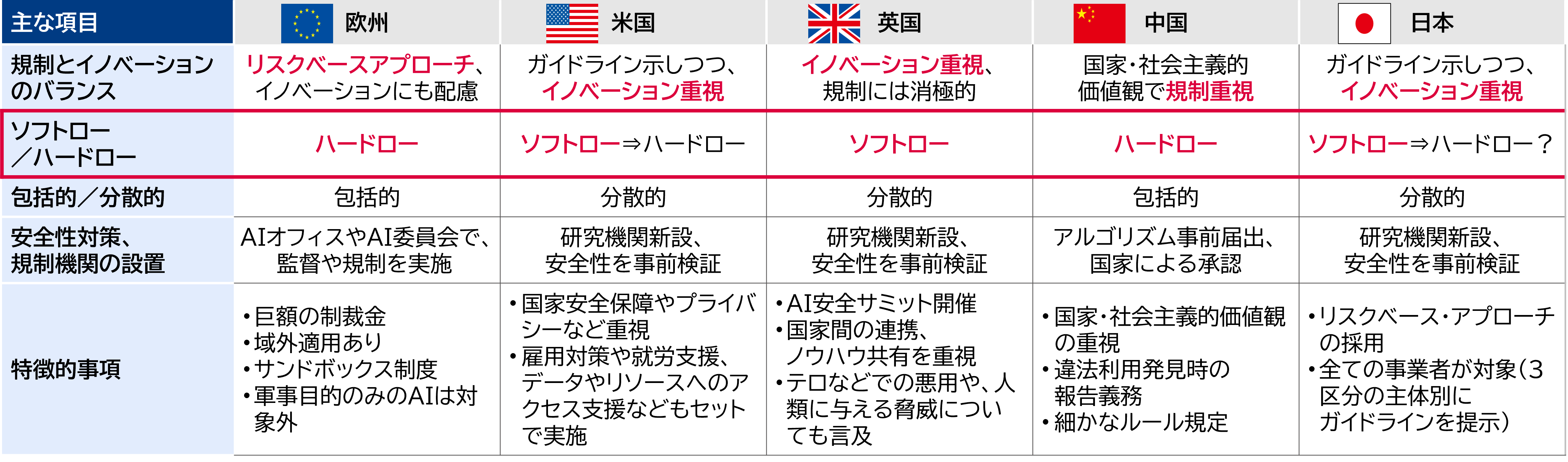

AIガバナンスに関する議論は以前より行われていたが、ChatGPTが2022年11月に公開されて以降、一層盛んとなっている。様々な議論を通じて、生成AIの急速な技術進歩に規制が追いついていない、各国のAI政策に温度差があるため国際連携した議論が必要、などの課題が認識されてきた。いわゆる「ハードロー」を採用して法規制を積極的に進める欧州や中国と、「ソフトロー」を採用して技術や産業の育成を重視する米国や日本とでは、AIガバナンスに対する考え方に違いがある。

このような課題認識のもと、2023年5月に広島で開催されたG7サミットではAIの活用や開発、規制について議論され、国際的なルール作りを推進する枠組みとして「広島AIプロセス」が創設された。広島AIプロセスはG7の関係閣僚が中心となり、OECDやGPAIなどの国際機関とも連携して議論が進められた。G7の議題として取り上げられるほど、AIに対する注目と国際的な議論の必要性が高まっていたのである。

このような課題認識のもと、2023年5月に広島で開催されたG7サミットではAIの活用や開発、規制について議論され、国際的なルール作りを推進する枠組みとして「広島AIプロセス」が創設された。広島AIプロセスはG7の関係閣僚が中心となり、OECDやGPAIなどの国際機関とも連携して議論が進められた。G7の議題として取り上げられるほど、AIに対する注目と国際的な議論の必要性が高まっていたのである。

出所:株式会社 三菱総合研究所

出所:株式会社 三菱総合研究所

G7広島AIプロセスでの議論の成果については、本コラムの後半で紹介する。

まずは、各国のAIガバナンスの状況を見てみよう。

まずは、各国のAIガバナンスの状況を見てみよう。

EU(欧州):ハードロー、リスクベース・アプローチによる包括的な規制

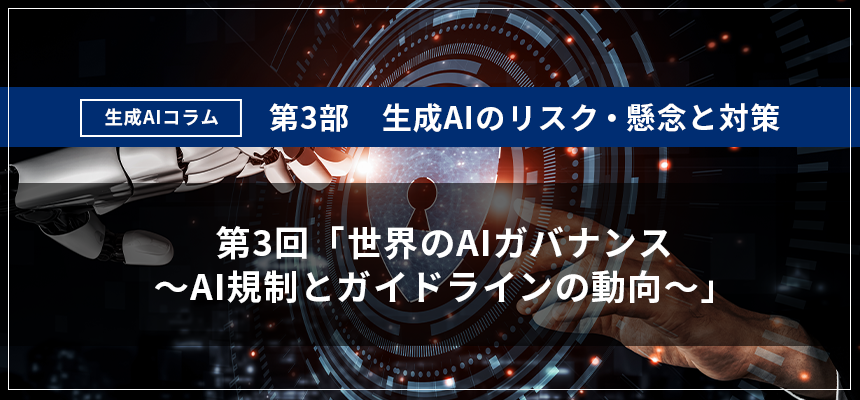

世界でもっとも規制の議論が進んでいるのは、EUだ。EUは歴史的な経緯もあり、自由、尊厳、平等など人権の保護に対する意識の高さを背景とした議論が展開されている。既に、生成AIが登場する以前の2021年4月には、AIによるリスクをレベルに応じた4段階で定義してガバナンスを行う「リスクベース・アプローチ」によるAI規則案が、EUの行政機関である欧州委員会から公表されていた。世界初となる包括的なAIの規則案である。

4段階のリスクレベルと対策は、リスクの高い順に、例えば以下の通りだ。ソーシャルスコアリングや人の認知行動を操作するAI、機微な特徴を利用した生体認証システムのAIなどは「禁止」、重要インフラや人材採用・選考AIなどは「規制(事前評価)」、チャットボットやリアルなコンテンツを生成するAIなどは「透明性確保」、上記レベル外のAIは「必須義務無し」である。生成AI登場後に議論されている修正案では、生成AIにも透明性確保が求められており、学習に用いたデータの著作権情報を公開すること、生成されたコンテンツにAI作成の旨を明示すること、などの義務が課されている。EU自体の市場が大きいだけでなく、違反すると巨額の制裁金が課されることや、域外適用もあることから、世界のAI市場に非常に大きな影響を及ぼすと考えられる。

修正案はその後、欧州委員会と、立法機関であるEU理事会および欧州議会による三者協議が行われ、2023年12月に大筋で暫定合意された。実は、EUのAI規則案に関しては、議論の過程でも当局と産業界、各国の間で意見の隔たりがあった。2022年6月には、EUのAI市場での競争力と技術的な主権を損なうという懸念から、およそ150の企業の経営者らが法案に反対する公開書簡に共同で署名している。フランス、ドイツ、イタリアも、自国AI企業の競争力低下の懸念から強い規制に反対したとされている

今後は、暫定合意に基づき詳細が詰められる予定だが、最終決定の内容や各国での運用状況については引き続き注目する必要がある。実効性の担保はAIガバナンスにおける共通の課題であり、EUの状況は世界のAI規制の議論や日本企業の事業に大きな影響を与えるものとなる。

4段階のリスクレベルと対策は、リスクの高い順に、例えば以下の通りだ。ソーシャルスコアリングや人の認知行動を操作するAI、機微な特徴を利用した生体認証システムのAIなどは「禁止」、重要インフラや人材採用・選考AIなどは「規制(事前評価)」、チャットボットやリアルなコンテンツを生成するAIなどは「透明性確保」、上記レベル外のAIは「必須義務無し」である。生成AI登場後に議論されている修正案では、生成AIにも透明性確保が求められており、学習に用いたデータの著作権情報を公開すること、生成されたコンテンツにAI作成の旨を明示すること、などの義務が課されている。EU自体の市場が大きいだけでなく、違反すると巨額の制裁金が課されることや、域外適用もあることから、世界のAI市場に非常に大きな影響を及ぼすと考えられる。

修正案はその後、欧州委員会と、立法機関であるEU理事会および欧州議会による三者協議が行われ、2023年12月に大筋で暫定合意された。実は、EUのAI規則案に関しては、議論の過程でも当局と産業界、各国の間で意見の隔たりがあった。2022年6月には、EUのAI市場での競争力と技術的な主権を損なうという懸念から、およそ150の企業の経営者らが法案に反対する公開書簡に共同で署名している。フランス、ドイツ、イタリアも、自国AI企業の競争力低下の懸念から強い規制に反対したとされている

今後は、暫定合意に基づき詳細が詰められる予定だが、最終決定の内容や各国での運用状況については引き続き注目する必要がある。実効性の担保はAIガバナンスにおける共通の課題であり、EUの状況は世界のAI規制の議論や日本企業の事業に大きな影響を与えるものとなる。

出所:株式会社 三菱総合研究所

出所:株式会社 三菱総合研究所

米国:ソフトローによる企業の自主規制、AIのイノベーションを重視

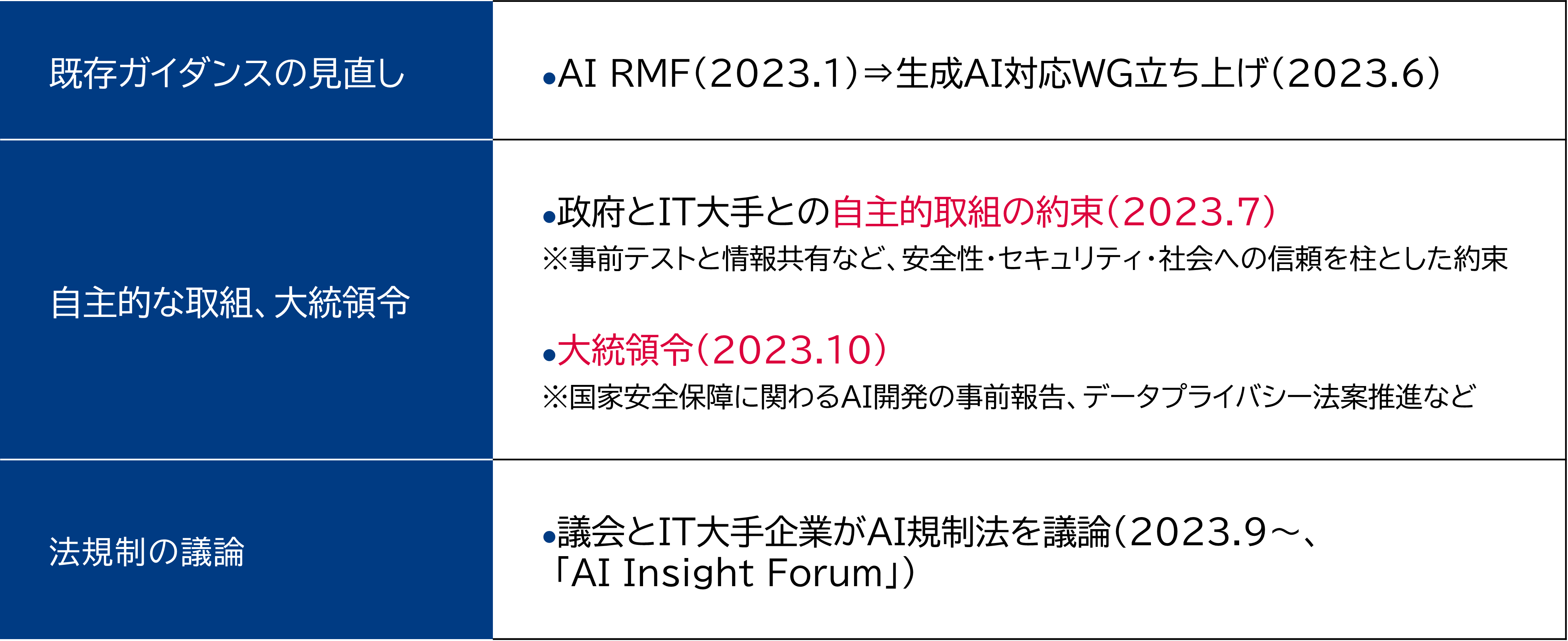

AI技術開発とAI産業で世界のトップを走っている米国は、これまで一貫して、技術開発と産業の育成によってイノベーションを重視する姿勢を維持してきた。企業の自主規制をベースとしながら、政府からの原則やガイドラインでリスクをマネジメントするガバナンスである。

代表的なものとして、「AI権利章典のための青写真」「AIリスクマネジメントフレームワーク(AI RMF)」がある。前者は、AIを含む自動化システムのガバナンスに際して、米国国民の人権を保護しつつ民主主義的価値を推進するよう求めたものである。安全で効果的なシステム、アルゴリズムによる差別からの保護、データのプライバシー、ユーザーへの通知と説明、人による代替手段・配慮・フォールバック、という考慮すべき5つの原則を提示している。後者は、AIシステムの開発・導入・利用などを担うAI関係者に対して、AIリスクの考え方、信頼できるAIシステムの特徴、実務でのリスクマネジメントなどを説明したものである。いずれも法的な拘束力はないものの、米国でAI事業を展開する企業は考慮すべき指針となっている。

このようなソフトローによるガバナンスが、生成AIの登場で変化しつつある。2023年6月にAI RMFの生成AI対応WGが立ち上げられたほか、7月には政府とIT大手企業とで生成AIに対応する自主的な取組が約束された。リリース前のセキュリティテスト実施と情報共有、コンテンツがAIで生成されたことを確認可能な透かしシステムなどの技術開発など、安全性・セキュリティ・社会の信頼獲得を柱とした8つの約束である。

10月には、この自主的な取組を発展させる形で大統領令が出されている。大統領令では、国防生産法に基づき深刻なリスクのあるAI開発時は政府へ事前報告すること、全ての米国人、特に子供を保護するデータプライバシー法案を推進すること、なども盛り込まれた。

また、2023年9月には、議会とIT大手企業とでAI規制法についての協議も始まっている。米国では今後、ソフトローを中心としつつ、ハードローも組み合わせたガバナンス形態へ移行していくと考えられる。具体的には、安全保障やプライバシーなどAIに関して政府が重要と捉えている領域で国家による法規制を推進する一方、その他の領域では引き続き企業の自主規制をベースにイノベーションを重視するような、ガバナンス対象の二極化が進む可能性がある。

代表的なものとして、「AI権利章典のための青写真」「AIリスクマネジメントフレームワーク(AI RMF)」がある。前者は、AIを含む自動化システムのガバナンスに際して、米国国民の人権を保護しつつ民主主義的価値を推進するよう求めたものである。安全で効果的なシステム、アルゴリズムによる差別からの保護、データのプライバシー、ユーザーへの通知と説明、人による代替手段・配慮・フォールバック、という考慮すべき5つの原則を提示している。後者は、AIシステムの開発・導入・利用などを担うAI関係者に対して、AIリスクの考え方、信頼できるAIシステムの特徴、実務でのリスクマネジメントなどを説明したものである。いずれも法的な拘束力はないものの、米国でAI事業を展開する企業は考慮すべき指針となっている。

このようなソフトローによるガバナンスが、生成AIの登場で変化しつつある。2023年6月にAI RMFの生成AI対応WGが立ち上げられたほか、7月には政府とIT大手企業とで生成AIに対応する自主的な取組が約束された。リリース前のセキュリティテスト実施と情報共有、コンテンツがAIで生成されたことを確認可能な透かしシステムなどの技術開発など、安全性・セキュリティ・社会の信頼獲得を柱とした8つの約束である。

10月には、この自主的な取組を発展させる形で大統領令が出されている。大統領令では、国防生産法に基づき深刻なリスクのあるAI開発時は政府へ事前報告すること、全ての米国人、特に子供を保護するデータプライバシー法案を推進すること、なども盛り込まれた。

また、2023年9月には、議会とIT大手企業とでAI規制法についての協議も始まっている。米国では今後、ソフトローを中心としつつ、ハードローも組み合わせたガバナンス形態へ移行していくと考えられる。具体的には、安全保障やプライバシーなどAIに関して政府が重要と捉えている領域で国家による法規制を推進する一方、その他の領域では引き続き企業の自主規制をベースにイノベーションを重視するような、ガバナンス対象の二極化が進む可能性がある。

出所:株式会社 三菱総合研究所

出所:株式会社 三菱総合研究所

英国:ソフトローでイノベーション重視、AIガバナンスでも存在感

英国は、欧州の中にあってもEUとは一線を画したガバナンス方針をとってきた。2021年9月に公表された「国家AI戦略」では、「科学およびAI超大国としてのリーダーシップの継続」が謳われており、世界のAI産業と技術開発をけん引する自負が認められる。実際、論文数を基にしたAIの国別ランキングでは、2020年~2022年は1位米国、2位中国、3位イギリスの3か国が上位を占めている。規制に関しては、2023年3月に発表された文書において、イノベーションの促進を重視して法規制は柔軟なアプローチを取ると宣言している。

AI規制には慎重な姿勢をもっている一方で、11月には世界初の「AI安全サミット」を自国で開催するなど、AIガバナンスでも世界に一定の存在感を示す意向があるとみられる。サミットでは、米・英・中・日など参加29カ国が署名した「ブレッチリー宣言」が採択され、AIの安全性に関するリスク研究や国際協力によるリスク対応などが合意されている。具体的には、英・米の両国はAIの安全性を研究する機関を設立し、先進的なAIモデルを国家主導で事前テストすることとなった。一方で、サミットでの合意内容を各国が具体的な施策としてどのように実行していくかに関しては、各国の状況によってアプローチが異なる可能性も言及されている。サミットは2024年も韓国、フランスで開催される予定だが、実効性の担保は引き続き課題となるだろう。

英国でのサミットには、G7やEUの議論に参加していない中国も招待された。米国は中国の招待に反対の姿勢を見せたとも伝えられているが、AIの国際的なガバナンスを論じる際に、中国抜きの議論は考えにくい。中国は、米国と並ぶAIの超大国だ。中国が議論に参加しなかった場合、国際的なルールや技術の一貫性を保つことが困難となり、ビジネスや技術開発において中国のみ先行する可能性もあり、経済安全保障面からの地政学的リスクが高まるだろう。国際的にルールが統一されない場合、ディープフェイクによる政治的な情報操作なども懸念される。

AIガバナンスをめぐる各国の動きには、自国のAI産業、安全保障上の思惑を背景とする主導権争いの側面もある。AIにおいても、国際的な枠組みへの参加を巡る政治的な駆け引きが続くだろう。例えば、2024年のG7議長国を務めるイタリアは、G7参加国で唯一、中国の巨大経済圏構想である「一帯一路」に参加していたが、2023年をもって離脱することが表明された。G7の議論と中国のAI政策をどのように協調させていくかは、世界のAIガバナンスにとって重要なポイントとなる。

AI規制には慎重な姿勢をもっている一方で、11月には世界初の「AI安全サミット」を自国で開催するなど、AIガバナンスでも世界に一定の存在感を示す意向があるとみられる。サミットでは、米・英・中・日など参加29カ国が署名した「ブレッチリー宣言」が採択され、AIの安全性に関するリスク研究や国際協力によるリスク対応などが合意されている。具体的には、英・米の両国はAIの安全性を研究する機関を設立し、先進的なAIモデルを国家主導で事前テストすることとなった。一方で、サミットでの合意内容を各国が具体的な施策としてどのように実行していくかに関しては、各国の状況によってアプローチが異なる可能性も言及されている。サミットは2024年も韓国、フランスで開催される予定だが、実効性の担保は引き続き課題となるだろう。

英国でのサミットには、G7やEUの議論に参加していない中国も招待された。米国は中国の招待に反対の姿勢を見せたとも伝えられているが、AIの国際的なガバナンスを論じる際に、中国抜きの議論は考えにくい。中国は、米国と並ぶAIの超大国だ。中国が議論に参加しなかった場合、国際的なルールや技術の一貫性を保つことが困難となり、ビジネスや技術開発において中国のみ先行する可能性もあり、経済安全保障面からの地政学的リスクが高まるだろう。国際的にルールが統一されない場合、ディープフェイクによる政治的な情報操作なども懸念される。

AIガバナンスをめぐる各国の動きには、自国のAI産業、安全保障上の思惑を背景とする主導権争いの側面もある。AIにおいても、国際的な枠組みへの参加を巡る政治的な駆け引きが続くだろう。例えば、2024年のG7議長国を務めるイタリアは、G7参加国で唯一、中国の巨大経済圏構想である「一帯一路」に参加していたが、2023年をもって離脱することが表明された。G7の議論と中国のAI政策をどのように協調させていくかは、世界のAIガバナンスにとって重要なポイントとなる。

中国:国家の社会主義的価値観重視、細かな規制ルールの導入

中国は、欧米企業からの自国産業の保護、国家による国民の価値観の管理を重視したガバナンスの姿勢を取っている。2023年8月には、世界初の生成AIを対象とした規制である「生成人工知能サービス管理暫行弁法」を施行した。この中では、生成されるコンテンツは国家の社会主義的価値観を反映していることや、国家の安全と利益を損なわないことが規定されている。具体的には、国家や社会主義体制の転覆の扇動、国家の安全と利益の危険、国のイメージの侵害、分離主義の扇動や国家統一・社会安定の侵害、テロリズムや過激主義の擁護、差別やプライバシーの侵害、などにつながるようなコンテンツの生成が禁止されている。この生成AIの規制法施行と同じタイミングで、生成AIが生成した画像・動画等のコンテンツへのラベル付与と周知などが規定されたガイドラインも提示されている。ラベルの大きさや含まれる情報、付与方法などが細かく指定されていることが特徴的だ。

また、2023年10月には、生成AIの問題の有無を判断するためのルール案に対して、意見募集がなされている。このルール案の内容も、定量的で細かいものとなっている。例えば、モデルの学習データセットから無作為抽出された4,000データのうち5%以上が違法でネガティブな情報の場合は学習から除外すること、政治や差別などに関係する2,000以上の試験的なプロンプトから生成される回答のルール違反が10%未満であること、などだ。あわせて、国の方針や第三者の苦情に対応できるよう、生成コンテンツの質を速やかに改善するためのモデレーターを雇用するといったモデル改善のためのルール案も示されている。

欧米諸国は多様な価値観や自由市場経済を重視しているのに対して、AI大国である中国は国家の社会主義的価値観を重視しており、ガバナンスの姿勢に相違がある。ガイドラインやルール案が何処まで実運用されるのか、国際的にも標準的な内容となり得るのか、日本にも影響が大きい中国のAIガバナンス動向は注目していく必要がある。

また、2023年10月には、生成AIの問題の有無を判断するためのルール案に対して、意見募集がなされている。このルール案の内容も、定量的で細かいものとなっている。例えば、モデルの学習データセットから無作為抽出された4,000データのうち5%以上が違法でネガティブな情報の場合は学習から除外すること、政治や差別などに関係する2,000以上の試験的なプロンプトから生成される回答のルール違反が10%未満であること、などだ。あわせて、国の方針や第三者の苦情に対応できるよう、生成コンテンツの質を速やかに改善するためのモデレーターを雇用するといったモデル改善のためのルール案も示されている。

欧米諸国は多様な価値観や自由市場経済を重視しているのに対して、AI大国である中国は国家の社会主義的価値観を重視しており、ガバナンスの姿勢に相違がある。ガイドラインやルール案が何処まで実運用されるのか、国際的にも標準的な内容となり得るのか、日本にも影響が大きい中国のAIガバナンス動向は注目していく必要がある。

日本:ソフトローでイノベーション重視、国内外の議論を反映したガイドライン

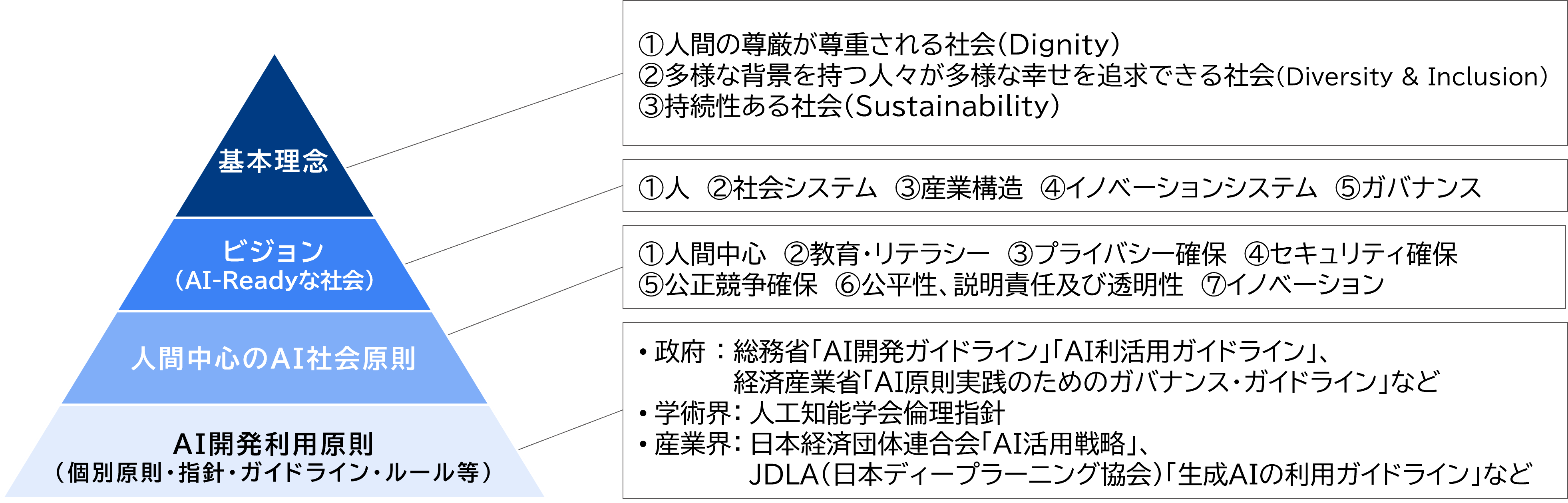

日本ではこれまで、技術や産業の育成によってイノベーションを重視する姿勢から、理念・原則やガイドラインによる現場の運用を重視してきた。代表的なものとして、内閣府の「人間中心のAI社会原則」、総務省の「AI開発ガイドライン」「AI利活用ガイドライン」、経済産業省の「AI原則実践のためのガバナンス・ガイドライン」などがある。いずれも法的拘束力のない分野横断的な原則やガイドラインである。基本理念・ビジョン・原則に沿った形で、産官学によるガイドラインが策定されてきた。

出所:「人間中心のAI社会原則」などより三菱総合研究所作成

出所:「人間中心のAI社会原則」などより三菱総合研究所作成

生成AI登場後の2023年5月には、それまでの「AI戦略実行会議」を改組し、法制度・倫理なども含め幅広く議論する「AI戦略会議」が立ち上げられた。AIの利用、懸念・リスク、AIの開発、などAIのガバナンスについて様々な論点が議論されている。生成AIをはじめ昨今のAIの状況にも対応したガイドラインとして、12月には「AI事業者ガイドライン案」も公表された。パブリックコメントを経て、2024年3月に正式公表予定である。

日本のガイドライン案は、既存の各省庁のガイドラインを統合・改定した包括的なガイドラインとなっており、AI戦略会議での国内の議論も反映されている。EUでも採用され世界的なスタンダードとなりつつあるリスクベース・アプローチの考え方が導入されている一方で、法的拘束力や罰則規定が無いなどの相違点もある。あくまでも、企業が自社の事業を考慮しながらリスクを評価し、AIガバナンスを構築・運用するためのガイドという位置付けだ。今後、日本の企業はこのガイドラインに沿ってAI事業とガバナンスを遂行していくこととなる。

日本のガイドライン案は、既存の各省庁のガイドラインを統合・改定した包括的なガイドラインとなっており、AI戦略会議での国内の議論も反映されている。EUでも採用され世界的なスタンダードとなりつつあるリスクベース・アプローチの考え方が導入されている一方で、法的拘束力や罰則規定が無いなどの相違点もある。あくまでも、企業が自社の事業を考慮しながらリスクを評価し、AIガバナンスを構築・運用するためのガイドという位置付けだ。今後、日本の企業はこのガイドラインに沿ってAI事業とガバナンスを遂行していくこととなる。

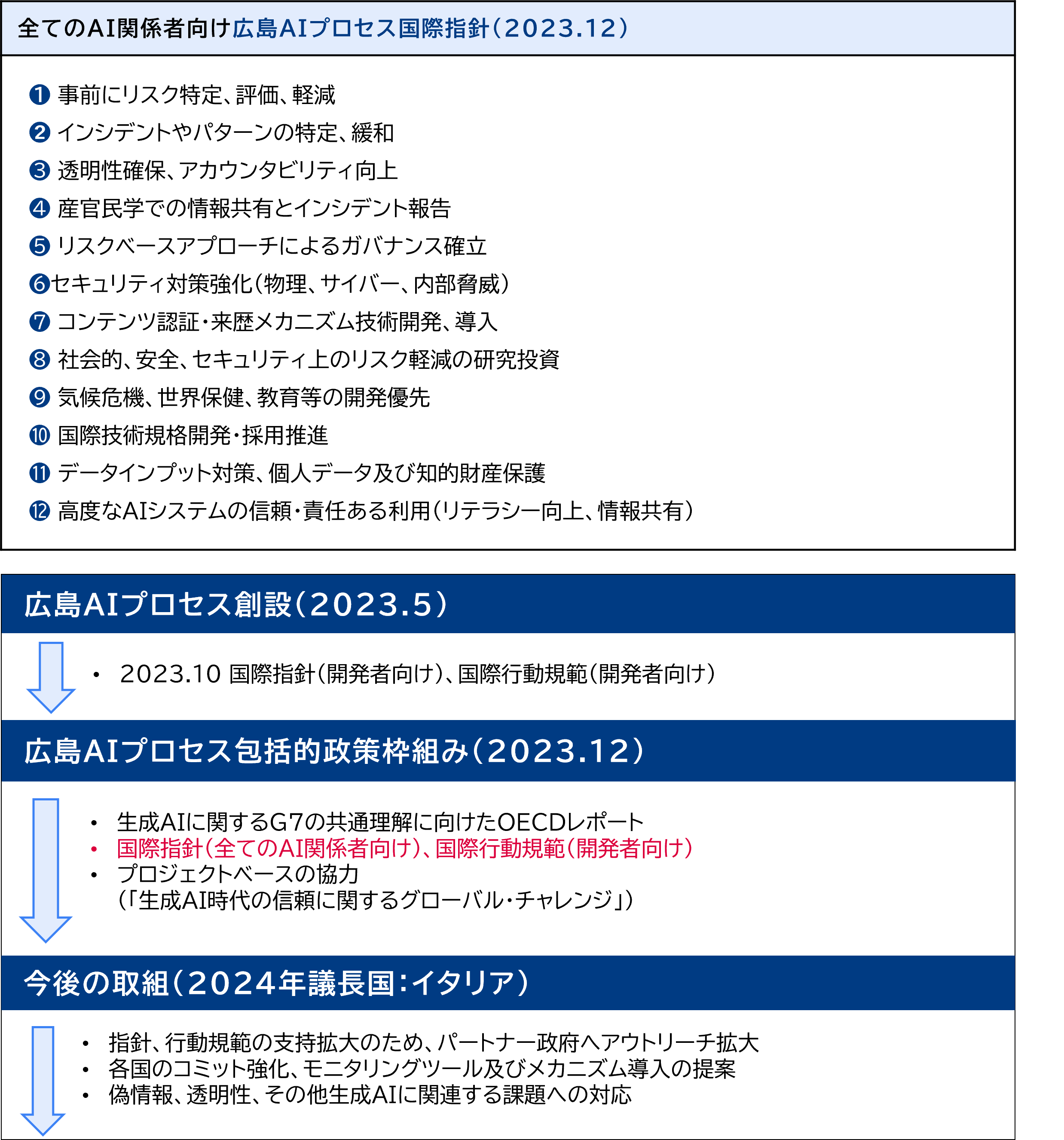

G7:AIの国際的かつ包括的なルールの策定、実効性が今後の課題

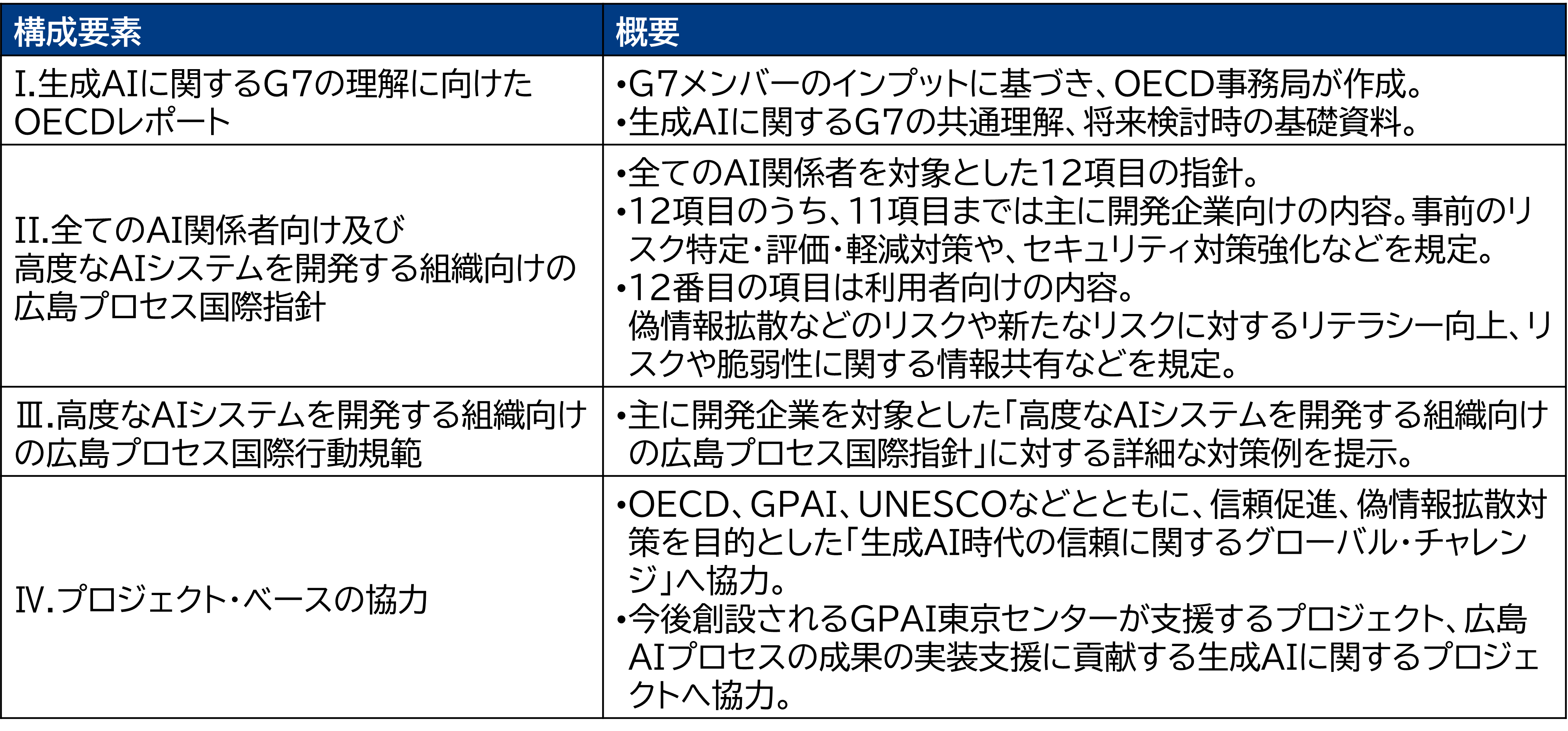

2023年のG7の議長国であった日本は、5月に創設された広島AIプロセスでの議論の結果をとりまとめ「広島AIプロセス包括的政策枠組み」を策定、12月に「広島AIプロセス G7デジタル・技術閣僚声明」として採択した。

広島AIプロセス包括的政策枠組みは、AIの国際的かつ包括的なルールである。「生成AIに関するG7の理解に向けたOECDレポート」、「全てのAI関係者向け及び高度なAIシステムを開発する組織向けの広島プロセス国際指針」、「高度なAIシステムを開発する組織向けの広島プロセス国際行動規範」、「プロジェクト・ベースの協力」の4つの要素から構成されている。

広島AIプロセス包括的政策枠組みは、AIの国際的かつ包括的なルールである。「生成AIに関するG7の理解に向けたOECDレポート」、「全てのAI関係者向け及び高度なAIシステムを開発する組織向けの広島プロセス国際指針」、「高度なAIシステムを開発する組織向けの広島プロセス国際行動規範」、「プロジェクト・ベースの協力」の4つの要素から構成されている。

出所:広島AIプロセスG7デジタル・技術閣僚声明などより三菱総合研究所作成

出所:広島AIプロセスG7デジタル・技術閣僚声明などより三菱総合研究所作成

2024年は、イタリアがG7の議長国となる。国際指針、国際行動規範の支持拡大のためのパートナー政府へのアウトリーチ拡大、各国のコミット強化やモニタリングツール、メカニズム導入の提案などが予定されている。どのように世界各国でAIガバナンスの実効性を高めていくかが課題となるだろう。生成AIの技術は日々進歩している。各国の取組を進めるとともに、国際的な議論も継続していく必要がある。

出所:広島AIプロセスG7デジタル・技術閣僚声明などより三菱総合研究所作成

出所:広島AIプロセスG7デジタル・技術閣僚声明などより三菱総合研究所作成

まとめ

本コラムで各国の状況を見てきたように、AIのガバナンスは国際的にはソフトローからハードロー化の流れにあり、規制やガイドラインの策定が進みつつある。2010年代~2020年代初頭は原理原則の議論がメインであったが、2022年11月のChatGPT登場を前後に、具体的なガイドラインやルールづくり、ハードロー化の議論が加速している。

出所:株式会社 三菱総合研究所

出所:株式会社 三菱総合研究所

各国のAIガバナンスの現状を比較すると、海外各国はテロなどでの悪用や国家安全保障等のリスクに言及している例があるほか、雇用対策や就労支援などもセットとしている例がある。

日本でも、国内外の議論を参考にしつつAIガバナンスの仕組みを構築しているところであり、海外各国と同様に、ソフトロー中心からハードローとの組み合わせへとガバナンスの仕組みが変化していく可能性もある。

日本でも、国内外の議論を参考にしつつAIガバナンスの仕組みを構築しているところであり、海外各国と同様に、ソフトロー中心からハードローとの組み合わせへとガバナンスの仕組みが変化していく可能性もある。

出所:本コラムで紹介した各国の法規類を参考に三菱総合研究所作成

出所:本コラムで紹介した各国の法規類を参考に三菱総合研究所作成

今後は、G7のような国際的な議論の枠組みでの成果をもとに、各国で具体的にAIガバナンスの施策を実行していくことが課題となる。

次回のコラムでは、日本のガバナンス施策であるAI事業者ガイドライン案の内容を紹介する。

次回のコラムでは、日本のガバナンス施策であるAI事業者ガイドライン案の内容を紹介する。

- 主要7か国首脳会議。フランス、米国、英国、ドイツ、日本、イタリア、カナダの7か国、およびEUが参加して毎年開催される首脳会議。

- Global Partnership on AI、2020年6月設立。人間中心の考え方に基づき、責任あるAIの開発と使用に取り組む国際機関

-

欧州連合日本政府代表部、EU AI規則案の最新動向、2023年9月

https://www.eu.emb-japan.go.jp/files/100551012.pdf(2024年1月5日閲覧) - 政治的志向・思想・人種・民族・宗教・性別など

- 最大3,500万ユーロ(約55億円)または全世界売上高7%の高い方

- EU域内の企業だけでなく、EU域内にAIを提供する企業も対象

-

Council of the EU Press release, 9 December 2023, Artificial intelligence act: Council

and Parliament strike a deal on the first rules for AI in the world(2024年1月5日閲覧)

https://www.consilium.europa.eu/en/press/press-releases/2023/12/09/artificial-intelligence-act-council-and-parliament-strike-a-deal-on-the-first-worldwide-rules-for-ai/ -

The White House, OCTOBER 04, 2022, Blueprint for an AI Bill of Rights: A Vision for Protecting Our Civil Rights in the Algorithmic Age(2024年1月5日閲覧)

https://www.whitehouse.gov/ostp/news-updates/2022/10/04/blueprint-for-an-ai-bill-of-rightsa-vision-for-protecting-our-civil-rights-in-the-algorithmic-age/ -

NIST, AI RISK MANAGEMENT FRAMEWORK(2024年1月5日閲覧)

https://www.nist.gov/itl/ai-risk-management-framework -

THE WHITE HOUSE, JULY 21, 2023, FACT SHEET: Biden-Harris Administration Secures Voluntary Commitments from Leading Artificial Intelligence Companies to Manage the Risks Posed by AI(2024年1月5日閲覧)

https://www.whitehouse.gov/briefing-room/statements-releases/2023/07/21/fact-sheet-biden-harris-administration-secures-voluntary-commitments-from-leading-artificial-intelligence-companies-to-manage-the-risks-posed-by-ai/ -

THE WHITE HOUSE, OCTOBER 30, 2023 FACT SHEET: President Biden Issues Executive Order on Safe, Secure, and Trustworthy Artificial Intelligence(2024年1月5日閲覧)

https://www.whitehouse.gov/briefing-room/statements-releases/2023/10/30/fact-sheet-president-biden-issues-executive-order-on-safe-secure-and-trustworthy-artificial-intelligence/ -

大統領令は、連邦議会や連邦最高裁の判断によって効力を失う可能性もあるものの、連邦政府職員に対して法的拘束力があるとされている。

アメリカンセンターJAPAN 米国の統治の仕組み–連邦政府(2024年1月5日閲覧)

https://americancenterjapan.com/aboutusa/translations/3162/ - 国家の安全保障、経済安全保障、公衆衛生や安全などに関わるリスク

-

NHKニュース 2023年9月14日 アメリカ議会 AI規制の法整備についてIT大手トップと初の協議(2024年1月5日閲覧)

https://www3.nhk.or.jp/news/html/20230914/k10014195021000.html -

総務省、令和5年版情報通信白書(2024年1月5日閲覧)

https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r05/html/datashu.html#f00259 -

GOV.UK, Policy paper, AI regulation: a pro-innovation approach(2024年1月5日閲覧)

https://www.gov.uk/government/publications/ai-regulation-a-pro-innovation-approach -

GOV.UK, Policy paper, The Bletchley Declaration by Countries Attending the AI Safety Summit, 1-2 November 2023(2024年1月5日閲覧)

https://www.gov.uk/government/publications/ai-safety-summit-2023-the-bletchley-declaration/the-bletchley-declaration-by-countries-attending-the-ai-safety-summit-1-2-november-2023 -

日本でも、AIの安全性研究や規格作成などを行う機関が設立される。

NHKニュース 2023年12月21日 生成AIの安全性など研究する国の機関 1月めどに設立へ 首相(2024年1月5日閲覧)

https://www3.nhk.or.jp/news/html/20231221/k10014294821000.html -

NHKニュース 2023年12月7日 イタリア 「一帯一路」からの離脱 中国側へ正式に伝える(2024年1月5日閲覧)

https://www3.nhk.or.jp/news/html/20231206/k10014280461000.html -

国家インターネット情報弁公室(CAC) 生成式人工智能服务管理暫行办法(生成AIサービスの運営に関する暫定措置)(2024年1月5日閲覧)

http://www.cac.gov.cn/2023-07/13/c_1690898327029107.htm -

国家情報セキュリティ標準化技術委員会(TC260) 网络安全标准实践指南—生成式人工智能服务内容标识方法(サイバーセキュリティ標準プラクティスガイド-生成AIサービスコンテンツ識別手法)(2024年1月5日閲覧)

https://www.tc260.org.cn/upload/2023-08-25/1692961404507050376.pdf -

国家情報セキュリティ標準化技術委員会(TC260) 生成式人工智能服务安全基本要求(生成AIサービス安全基本要求)(2024年1月5日閲覧)

https://www.tc260.org.cn/upload/2023-10-11/1697008495851003865.pdf -

内閣府統合イノベーション戦略推進会議 人間中心のAI社会原則(2024年1月5日閲覧)

https://www8.cao.go.jp/cstp/aigensoku.pdf -

総務省AIネットワーク社会推進会議 国際的な議論のためのAI開発ガイドライン案(2024年1月5日閲覧)

https://www.soumu.go.jp/main_content/000499625.pdf -

総務省AIネットワーク社会推進会議 AI利活用ガイドライン~AI利活用のためのプラクティカルリファレンス~(2024年1月5日閲覧)

https://www.soumu.go.jp/main_content/000637097.pdf -

経済産業省AI原則の実践の在り方に関する検討会AIガバナンス・ガイドラインWG AI原則実践のためのガバナンス・ガイドラインVer. 1.1(2024年1月5日閲覧)

https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20220128_1.pdf -

総務省 経済産業省、AI事業者ガイドライン案(2024年1月5日閲覧)

https://www8.cao.go.jp/cstp/ai/ai_senryaku/7kai/13gaidorain.pdf -

総務省 令和5年12月1日 G7デジタル・技術大臣会合の開催結果(2024年1月5日閲覧)

https://www.soumu.go.jp/menu_news/s-news/01tsushin06_02000283.html -

OECD, G7 Hiroshima Process on Generative Artificial Intelligence (AI) Towards a G7 Common Understanding on Generative AI(2024年1月5日閲覧)

https://www.oecd-ilibrary.org/science-and-technology/g7-hiroshima-process-on-generative-artificial-intelligence-ai_bf3c0c60-en -

広島AIプロセスを補完する文書として、AIのセキュリティ部分を詳述した「セキュアAIシステム開発ガイドライン」も策定されている。

セキュアAIシステム開発ガイドラインについて 令和5年11月28日 内閣府科学技術・イノベーション推進事務局内閣官房内閣サイバーセキュリティセンタープレスリリース(2024年1月5日閲覧)

https://www8.cao.go.jp/cstp/stmain/20231128ai.html - EUのAI規則案では、軍事目的のみのAIは対象外としている。